川原繁人 言語学者として、親として、「子ども向け対話アプリ」に感じたこと。【著者に聞く】

――本書執筆の経緯を教えてください。

子ども向けの対話型AIアプリが登場したと聞いたとき、直感的に心配になりました。私も妻(桃生朋子(ものうともこ)氏)も言語学者で、二人の小学生の親でもあります。本書ではその立場から、幼児が生成AIと会話をすることは、成長という観点から「安全」なのだろうか、という問いに向き合いました。

――新しいテクノロジーが登場すると、不安は常に生まれます。対話型AIは、これまでとはどう違うのでしょうか。

今は、壮大な人体実験の最中のようなものだと思っています。たとえば新薬の場合、臨床試験を経て、安全性を確認してから商品化されますよね。しかし対話型AIは、3年前にOpenAIがChatGPTをリリースしたのち、人間の精神や発達に与える影響について検証がしっかりとされないまま、世界中にばらまかれてしまった状態です。

AIと人間言語は、学習のデータの質も量もまったく違います。人間は音から学ぶけれど、AIは文字から学ぶ。AIは人間が読むと何千年もかかるような厖大(ぼうだい)なデータを読むことで、言語らしきものを返せるようになりました。逆に人間の子どもは、はるかに少ない量の情報から言葉を習得しているわけで、言語学者は、そこに感動を覚えて研究しているのです。AIと人間の言語は、表面的には似て見えるけれど、本質的に同じであるはずがない。

さらに不安と脅威を感じているのは、「心」の問題です。AIには表情・感情といった身体性が欠如しています。また子どもは、「友だちとケンカした」「こんなことを言われて傷ついた」といった経験を通して、人間同士のコミュニケーションを学んでいきますよね。どんな言葉をぶつけても傷つかない、いつ何を話しても肯定的に返答するAIとの対話が、子どもの成長にとって良いものなのか、とても不安です。

仮に、このような問題について対応できるよう、技術者たちが設計していけば解決するのかもしれません。─しかし、どんな問題が生じるかもわからない現在は、まさに「実験中」だと思うのです。なお、OpenAIのCEO、サム・アルトマンも、「自分の息子には対話型AIと親友になって欲しくない」と述べています。

――川原さん自身が、AIと"友だち"になりかけたエピソードもありました。

私の場合、最初は「ハルシネーション(幻覚)を探してやろう」みたいな、敵対心から使用していました(笑)。粗を探すつもりで、いろいろ試しているうちに、AIが意外と面白い答えを返してきたり、「性格」のようなAIごとの傾向が見えてきたり......。いつの間にか、お気に入りの学術議論相手になってしまっていました。

目が覚めたきっかけは、子どもに「私は使っちゃいけないのに、なんでお父さんは使ってるの?」と言われたことです。子どもと過ごせる時間に、AIとチャットをしてしまっている自分がいることにも気付きました。依存に陥らず距離を取って、どう道具として使っていけばよいのか。難しさを実感しました。

――本書終盤では、さらに背後にある「スマホ問題」にも言及しています。今後のスマホやAIとの共存について、どのようにお考えですか。

私も妻も、子どものスマホ使用に対して慎重な姿勢を取っていますが、最終的には各家庭の判断であるべきだと思っています。その上で、スマホやタブレットを使う「スクリーンタイム」が発達に与える影響や、依存とエコーチェンバー問題など、言語学という専門分野からは外れるかもしれませんが、現役子育て世代の研究者としての考えを述べました。

年齢制限についての厳格な運用や、ガイドラインなどが必要だと感じる一方、これからの社会では、もうAIを否定して生きていくことはできません。技術の発展はもちろん素晴らしいのですが、「子どもと対話型AI」という点では、本書を書き終えても、慎重な姿勢は変わりませんでした。リスクを考慮しながら共存の道を探し続けるしかないと、今は考えています。

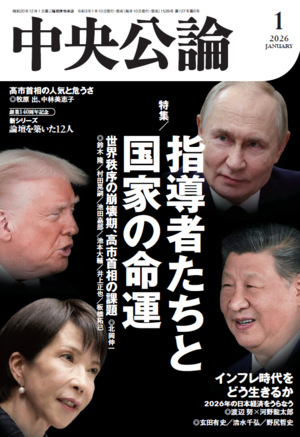

(『中央公論』2026年1月号より)

1980年生まれ。慶應義塾大学言語文化研究所教授。2007年マサチューセッツ大学より博士号(言語学)。複数のアメリカの大学にて教鞭を執ったのち、現職。専門は言語学、音声学。著書に『音とことばのふしぎな世界』『音声学者、娘とことばの不思議に飛び込む』など。